Denne artikel vil diskutere nogle af måderne til at gennemgå et websted, herunder værktøjer til webcrawling, og hvordan man bruger disse værktøjer til forskellige funktioner. De værktøjer, der diskuteres i denne artikel, inkluderer:

- HTTrack

- Cyotek WebCopy

- Content Grabber

- ParseHub

- OutWit Hub

HTTrack

HTTrack er en gratis og open source-software, der bruges til at downloade data fra websteder på internettet. Det er en nem at bruge software udviklet af Xavier Roche. De downloadede data gemmes på localhost i samme struktur som på det oprindelige websted. Proceduren for at bruge dette værktøj er som følger:

Først skal du installere HTTrack på din maskine ved at køre følgende kommando:

[e-mail-beskyttet]: ~ $ sudo apt-get install httrackEfter installation af softwaren skal du køre følgende kommando for at gennemgå webstedet. I det følgende eksempel gennemgår vi linuxhint.com:

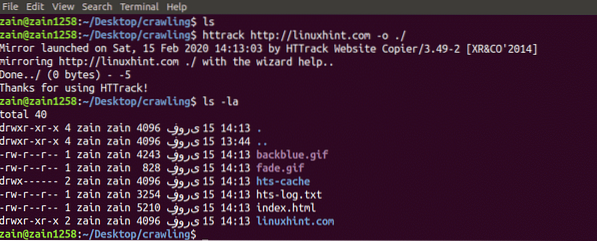

[e-mail-beskyttet]: ~ $ httrack http: // www.linuxhint.com -o ./Ovenstående kommando henter alle data fra webstedet og gemmer dem i den aktuelle mappe. Følgende billede beskriver, hvordan man bruger httrack:

Fra figuren kan vi se, at dataene fra webstedet er hentet og gemt i den aktuelle mappe.

Cyotek WebCopy

Cyotek WebCopy er en gratis webcrawling software, der bruges til at kopiere indhold fra et websted til localhost. Efter at have kørt programmet og leveret webstedslinket og destinationsmappen, vil hele webstedet blive kopieret fra den givne URL og gemt i localhost. Hent Cyotek WebCopy fra følgende link:

https: // www.cyotek.com / cyotek-webkopi / downloads

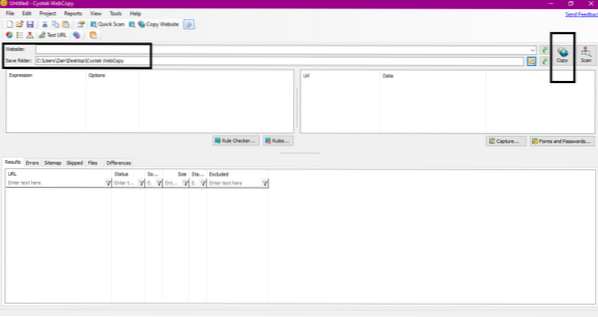

Efter installationen, når webcrawleren køres, vises vinduet nedenfor:

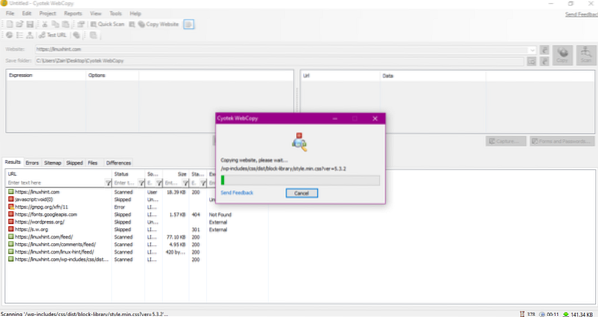

Når du indtaster webadressens websted og udpeger destinationsmappen i de krævede felter, skal du klikke på kopi for at begynde at kopiere dataene fra webstedet, som vist nedenfor:

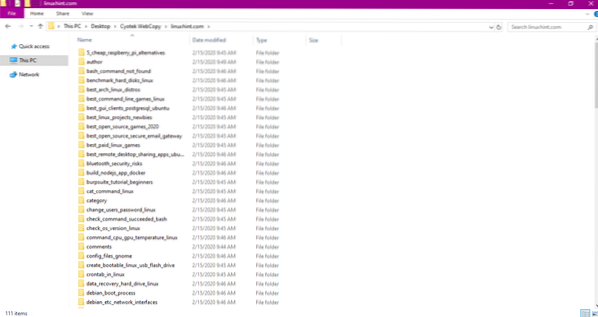

Efter kopiering af dataene fra webstedet skal du kontrollere, om dataene er kopieret til destinationsmappen som følger:

I ovenstående billede er alle data fra webstedet kopieret og gemt på målplaceringen.

Content Grabber

Content Grabber er et skybaseret softwareprogram, der bruges til at udtrække data fra et websted. Det kan udtrække data fra ethvert websted med flere strukturer. Du kan downloade Content Grabber fra følgende link

http: // www.tukuer.com / preview / 1601497 / Content-Grabber

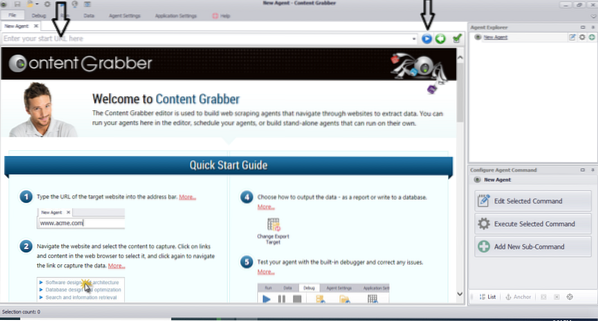

Efter installation og kørsel af programmet vises et vindue som vist i følgende figur:

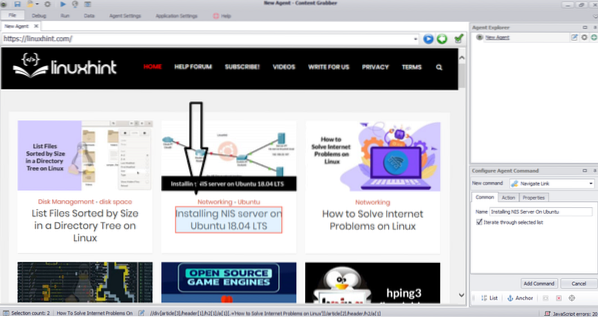

Indtast URL'en til det websted, hvorfra du vil udtrække data. Når du har indtastet webadressens websted, skal du vælge det element, du vil kopiere, som vist nedenfor:

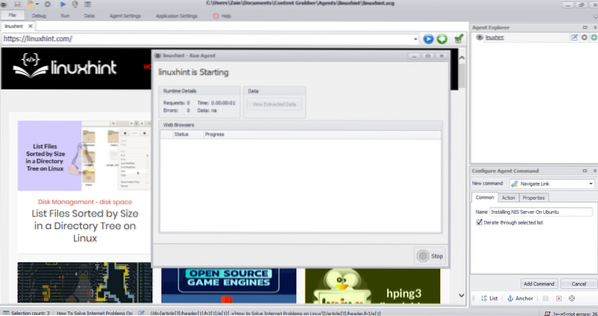

Når du har valgt det nødvendige element, skal du begynde at kopiere data fra webstedet. Dette skal se ud som følgende billede:

De data, der ekstraheres fra et websted, gemmes som standard på følgende placering:

C: \ Brugere \ brugernavn \ Dokument \ Content GrabberParseHub

ParseHub er et gratis og brugervenligt webcrawlingværktøj. Dette program kan kopiere billeder, tekst og andre former for data fra et websted. Klik på følgende link for at downloade ParseHub:

https: // www.parsehub.com / hurtigstart

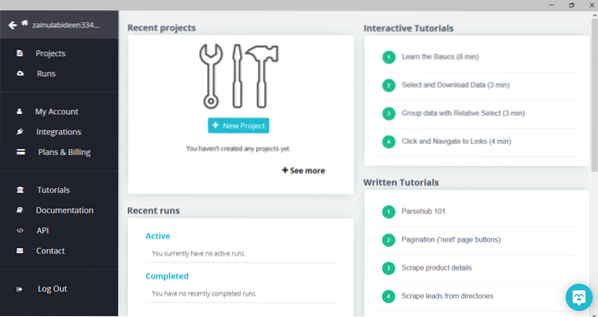

Efter download og installation af ParseHub skal du køre programmet. Et vindue vises som vist nedenfor:

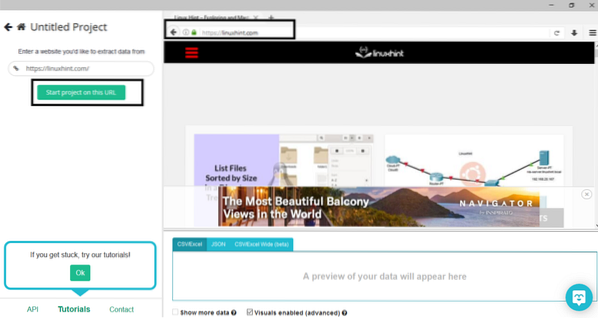

Klik på "Nyt projekt", indtast URL'en i adresselinjen på det websted, hvorfra du ønsker at udtrække data, og tryk på enter. Klik derefter på “Start projekt på denne URL.”

Når du har valgt den ønskede side, skal du klikke på "Hent data" i venstre side for at gennemgå websiden. Følgende vindue vises:

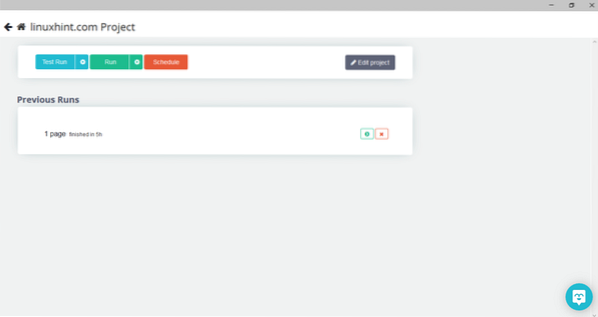

Klik på "Kør", og programmet beder om den datatype, du ønsker at downloade. Vælg den ønskede type, og programmet beder om destinationsmappen. Gem endelig dataene i destinationsmappen.

OutWit Hub

OutWit Hub er en webcrawler, der bruges til at udtrække data fra websteder. Dette program kan udtrække billeder, links, kontakter, data og tekst fra et websted. De eneste nødvendige trin er at indtaste webadressen på webstedet og vælge den datatype, der skal ekstraheres. Download denne software fra følgende link:

https: // www.overvinde.com / produkter / hub /

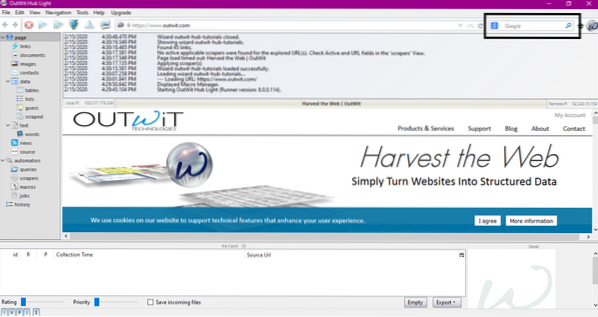

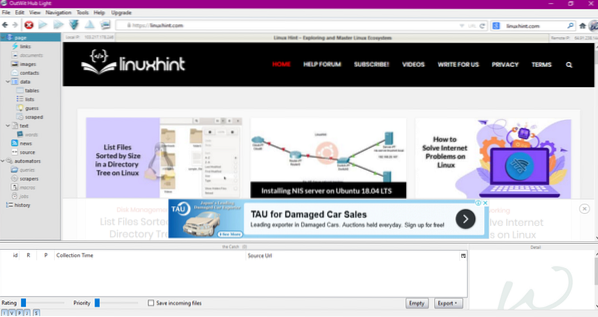

Efter installation og kørsel af programmet vises følgende vindue:

Indtast webadressen til webstedet i det felt, der vises i ovenstående billede, og tryk på enter. Vinduet viser hjemmesiden som vist nedenfor:

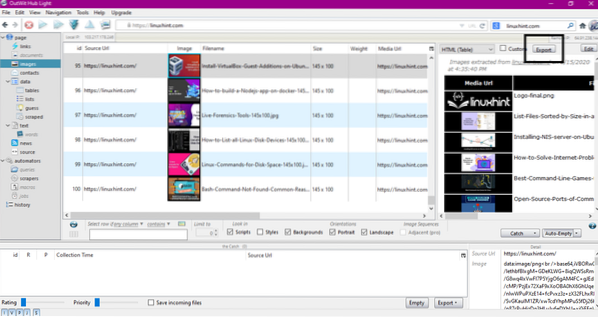

Vælg den datatype, du vil udtrække fra webstedet, fra panelet til venstre. Følgende billede illustrerer denne proces nøjagtigt:

Vælg nu det billede, du vil gemme på localhost, og klik på eksportknappen markeret i billedet. Programmet beder om destinationsmappen og gemmer dataene i telefonbogen.

Konklusion

Webcrawlere bruges til at udtrække data fra websteder. Denne artikel diskuterede nogle web-gennemgangsværktøjer og hvordan man bruger dem. Brug af hver webcrawler blev diskuteret trin for trin med tal, hvor det var nødvendigt. Jeg håber, at efter at have læst denne artikel, vil du finde det nemt at bruge disse værktøjer til at gennemgå et websted.

Phenquestions

Phenquestions